Precio de Diamantes

Primera parte: Entendiendo el problema y propuesta de la solución

Contexto

Imaginemos que la empresa IDR (Intelligent Diamond Reseller) está interesado en el negocio de la compra y venta de diamantes. Ellos compran diamantes al precio más bajo posible y luego, lo venden a un mayor precio para obtener una ganancia.

La empresa necesita tener un modelo predictivo para definir un precio de compra para mejorar su competitividad en el mercado, disminuyendo sus costos.

La empresa le envia un dataset que contiene el precio y las caracteristicas de alrededor de 54.000 diamantes. En esta se pueden contemplar las siguientes caracteristicas:

- Dimensión: 53.940 observaciones y 10 variables.

- Unidad de observación: Diamantes

- Las variables son:

- price: Precio en dólares americanos.

- carat: Peso del diamante en quilates (un quilate son 0,2 gramos).

- cut: Calidad del corte (fair, good, very good, premium, ideal).

- color: El color del diamante desde J (lo peor) hasta D (lo mejor).

- clarity: Medida de claridad del diamante. De peor a mejor: I1, SI2, SI1, VS2, VS1, VVS2, VVS1, IF.

- x: Largo en milimetros.

- y: Ancho en milimetros.

- z: Profundidad en milimetros.

- depth: Porcentaje de la profundidad total (z/promedio entre x e y).

- table: Ancho de la parte superior del diamante en relación con el punto más ancho.

En base al sitio https://www.diamonds.pro/ los factores más importantes para definir el precio del diamante son el peso, el color, la claridad y el corte. Son buenas noticias, dado que tenemos todas esas caracteristicas en nuestro dataset.

Además de poner atención en lo que tenemos, es importante observar que información nos puede faltar. Para este dataset nos falta saber si los diamantes tienen una certificación o no. Los clientes están dispuestos a pagar más si el diamante tiene certificación y por eso es importante hablar con la empresa IDR para que nos dé información adicional. En este caso, todos los diamantes de la base de datos cuentan con certificación.

Es fundamental realizar reuniones con las personas involucradas de la empresa para definir expectativas, cuales son los datos importantes dentro de una persectiva de negocios, definir el impacto de la solución en terminos medibles (horas ahorradas, dinero, etc), conocer el contexto/negocio de la empresa, etc. Todo esto es para entender el problema en su totalidad y definir objetivos y metodologías para dar solución a este problema.

Objetivos

Los objetivos para este problema son los siguientes:

- Usar todas las columnas del dataset, excepto el precio.

- Construir un modelo que prediga el precio de diamantes lo más preciso posible, basado en los atributos.

- Predecir los precios de los diamantes ofrecidos por el proveedor para que IDR decida cuánto pagará por ellos.

Metodología

La variable objetivo a predecir es el precio del diamante, por lo que los atributos o columnas restantes serán 9. Como hablamos de precio la variable a predecir es una variable continua. El tipo de problema que abordaremos es un problema de regresión. Cuando la variable objetivo es continua, estamos dentro de una categoría de problemas llamado tareas de regresiones.

Para la evaluación del modelo, si la predicción está cerca de los valores reales es considerada buena y viceversa.

La forma en que los usuarios finales verán el modelo también se debe conversar en los primeros momentos. Es importante saber si el área comercial de IDR desea ver los resultados del modelo a través de una página web, aplicación, cloud computing, etc. Para este ejercicio, la producción del modelo será en una página web con Dash.

Segunda parte: Recolectar y preparar los datos

La recolección de los datos va dependiendo del proyecto. A veces tenemos que nosotros buscar los datos utilizando la tecnología ETL (extract, transform, load), pedir acceso a la base de datos de la compañia o conectarse a data externa como Bloomberg, Quandl o alguna API REST.

Para este caso, la data es extraida de Kaggle (https://www.kaggle.com/shivam2503/diamonds)

# importamos las librerías que necesitamos para esta segunda parte.

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import warnings

warnings.filterwarnings("ignore")

%matplotlib inline

# importamos el dataset.

diamonds = pd.read_csv('diamonds.csv')Ya con la base de datos importada, es buena práctica realizar una primera aproximación para corroborar que los datos hayan sido correctamente importados.

# Vemos las primeras 5 observaciones del dataframe

diamonds.head()| Unnamed: 0 | carat | cut | color | clarity | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|---|---|---|---|

| 0 | 1 | 0.23 | Ideal | E | SI2 | 61.5 | 55.0 | 326 | 3.95 | 3.98 | 2.43 |

| 1 | 2 | 0.21 | Premium | E | SI1 | 59.8 | 61.0 | 326 | 3.89 | 3.84 | 2.31 |

| 2 | 3 | 0.23 | Good | E | VS1 | 56.9 | 65.0 | 327 | 4.05 | 4.07 | 2.31 |

| 3 | 4 | 0.29 | Premium | I | VS2 | 62.4 | 58.0 | 334 | 4.20 | 4.23 | 2.63 |

| 4 | 5 | 0.31 | Good | J | SI2 | 63.3 | 58.0 | 335 | 4.34 | 4.35 | 2.75 |

Vemos que hay una columna llamada "Unnamed: 0". Nos podemos deshacer de ella usando otra forma de importar el dataframe

diamonds = pd.read_csv('diamonds.csv', index_col=0)

diamonds.head()| carat | cut | color | clarity | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0.23 | Ideal | E | SI2 | 61.5 | 55.0 | 326 | 3.95 | 3.98 | 2.43 |

| 2 | 0.21 | Premium | E | SI1 | 59.8 | 61.0 | 326 | 3.89 | 3.84 | 2.31 |

| 3 | 0.23 | Good | E | VS1 | 56.9 | 65.0 | 327 | 4.05 | 4.07 | 2.31 |

| 4 | 0.29 | Premium | I | VS2 | 62.4 | 58.0 | 334 | 4.20 | 4.23 | 2.63 |

| 5 | 0.31 | Good | J | SI2 | 63.3 | 58.0 | 335 | 4.34 | 4.35 | 2.75 |

Ahora que vemos que la importación fue éxitosa, podemos seguir explorando...

# dimensión del dataframe

print('Cantidad de observaciones: {}.\nCantidad de atributos: {}.'.format(*diamonds.shape))

Cantidad de observaciones: 53940.

Cantidad de atributos: 10.

diamonds.describe()Cantidad de observaciones: 53940. Cantidad de atributos: 10.

diamonds.describe()| carat | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|

| count | 53940.000000 | 53940.000000 | 53940.000000 | 53940.000000 | 53940.000000 | 53940.000000 | 53940.000000 |

| mean | 0.797940 | 61.749405 | 57.457184 | 3932.799722 | 5.731157 | 5.734526 | 3.538734 |

| std | 0.474011 | 1.432621 | 2.234491 | 3989.439738 | 1.121761 | 1.142135 | 0.705699 |

| min | 0.200000 | 43.000000 | 43.000000 | 326.000000 | 0.000000 | 0.000000 | 0.000000 |

| 25% | 0.400000 | 61.000000 | 56.000000 | 950.000000 | 4.710000 | 4.720000 | 2.910000 |

| 50% | 0.700000 | 61.800000 | 57.000000 | 2401.000000 | 5.700000 | 5.710000 | 3.530000 |

| 75% | 1.040000 | 62.500000 | 59.000000 | 5324.250000 | 6.540000 | 6.540000 | 4.040000 |

| max | 5.010000 | 79.000000 | 95.000000 | 18823.000000 | 10.740000 | 58.900000 | 31.800000 |

El output anterior es muy util para un checkeo rápido de valores extraños, como por ejemplo valores negativos o ceros en la fila "min" que en este contexto no deberían existir.

Podemos ver que hay un valor que hace ruido: En el atributo carat o peso del diamante, encontramos que el máximo es 5,01, siendo demasiado alto. Sabemos que es alto considerando que el percentil 75 es 1,04 lo que es una gran diferencia. Es por tanto considerado como candidato a un valor atípico (outlier en inglés).

Aunque existan valores atípicos, no necesariamente significa que tendremos que deshacernos de ellos; nuevamente depende del contexto. Como en este caso, las demás variables se ven bien o dentro de un rango apropiado, no excluiremos ese valor.

En otros contextos, por ejemplo, en el análisis de ingresos generales de la población de USA, probablemente no incluiremos a Jeff Bezos en en análisis. Todo depende si lo consideramos apropiado o no según los objetivos propuestos.

Nota : Se considera valor atípico cuando el valor es mayor al percentil 75 en al menor 1,5 veces el rango intercuartílico o menor al percentil 25 en al menos 1,5 veces el rango intercuartílico.

Manejando los valores pérdidos

La limpieza de datos por lo general toma mucho esfuerzo y tiempo. No hay un estándar de como hacerlo, porque cada proceso es único para todos los datasets. Para este caso, no es tanto trabajo, pero no siempre tendremos esa suerte.

Vamos a comenzar analizando las variables x, y, z dado que llama la atención que el valor mínimo de estas variables sea 0, es decir, es como si se tratasen de diamantes 2D

diamonds.loc[diamonds.x==0]| carat | cut | color | clarity | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|---|---|---|

| 11183 | 1.07 | Ideal | F | SI2 | 61.6 | 56.0 | 4954 | 0.0 | 6.62 | 0.0 |

| 11964 | 1.00 | Very Good | H | VS2 | 63.3 | 53.0 | 5139 | 0.0 | 0.00 | 0.0 |

| 15952 | 1.14 | Fair | G | VS1 | 57.5 | 67.0 | 6381 | 0.0 | 0.00 | 0.0 |

| 24521 | 1.56 | Ideal | G | VS2 | 62.2 | 54.0 | 12800 | 0.0 | 0.00 | 0.0 |

| 26244 | 1.20 | Premium | D | VVS1 | 62.1 | 59.0 | 15686 | 0.0 | 0.00 | 0.0 |

| 27430 | 2.25 | Premium | H | SI2 | 62.8 | 59.0 | 18034 | 0.0 | 0.00 | 0.0 |

| 49557 | 0.71 | Good | F | SI2 | 64.1 | 60.0 | 2130 | 0.0 | 0.00 | 0.0 |

| 49558 | 0.71 | Good | F | SI2 | 64.1 | 60.0 | 2130 | 0.0 | 0.00 | 0.0 |

Vemos que las variables de profundidad para z que son 0 también lo son para las variables x e y (excepto por uno). Tiene sentido entonces tratar estos valores 0 como datos pérdidos.

Hay muchas formas de tratar valores pérdidos, desde eliminando la observación completa a utilizar algoritmos de imputación que intentan adivinar el mejor valor para sustituir el valor pérdido, como por ejemplo, utilizar K-nearest neighbors.

Para mantener el ejercicio simple, excluiremos las observaciones donde x, y, z son datos pérdidos. Perderemos información, pero hay 53.940 observaciones, por lo que perder 7 no será un mayor problema.

diamonds = diamonds.loc[(diamonds.x > 0) | (diamonds.y > 0)]Ahora solo nos falta lidiar con un valor pérdido en la fila 11183, dado que el valor de "y" es mayor a cero.

diamonds.loc[11183]carat 1.07 cut Ideal color F clarity SI2 depth 61.6 table 56 price 4954 x 0 y 6.62 z 0 Name: 11183, dtype: object

Siendo que este diamante no está muy alejado del precio promedio o el peso promedio, podremos reemplar el valor pérdido de x con su mediana, porque al estar al medio de una distribución continua es un buen indicador de un valor tipico, además no está afecta a los valores atípicos, como si lo está el promedio.

diamonds.loc[11183, 'x'] = diamonds.x.median()

diamonds.loc[diamonds['x']==0].shape(0, 10)

Ahora vemos que no tenemos valores pérdidos para x. Vamos a repetir el mismo proceso para z, dado que ya lidiamos con los valores pérdidos de y.

diamonds.loc[diamonds.y==0]| carat | cut | color | clarity | depth | table | price | x | y | z |

|---|

diamonds.loc[diamonds.z==0]| carat | cut | color | clarity | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|---|---|---|

| 2208 | 1.00 | Premium | G | SI2 | 59.1 | 59.0 | 3142 | 6.55 | 6.48 | 0.0 |

| 2315 | 1.01 | Premium | H | I1 | 58.1 | 59.0 | 3167 | 6.66 | 6.60 | 0.0 |

| 4792 | 1.10 | Premium | G | SI2 | 63.0 | 59.0 | 3696 | 6.50 | 6.47 | 0.0 |

| 5472 | 1.01 | Premium | F | SI2 | 59.2 | 58.0 | 3837 | 6.50 | 6.47 | 0.0 |

| 10168 | 1.50 | Good | G | I1 | 64.0 | 61.0 | 4731 | 7.15 | 7.04 | 0.0 |

| 11183 | 1.07 | Ideal | F | SI2 | 61.6 | 56.0 | 4954 | 5.70 | 6.62 | 0.0 |

| 13602 | 1.15 | Ideal | G | VS2 | 59.2 | 56.0 | 5564 | 6.88 | 6.83 | 0.0 |

| 24395 | 2.18 | Premium | H | SI2 | 59.4 | 61.0 | 12631 | 8.49 | 8.45 | 0.0 |

| 26124 | 2.25 | Premium | I | SI1 | 61.3 | 58.0 | 15397 | 8.52 | 8.42 | 0.0 |

| 27113 | 2.20 | Premium | H | SI1 | 61.2 | 59.0 | 17265 | 8.42 | 8.37 | 0.0 |

| 27504 | 2.02 | Premium | H | VS2 | 62.7 | 53.0 | 18207 | 8.02 | 7.95 | 0.0 |

| 27740 | 2.80 | Good | G | SI2 | 63.8 | 58.0 | 18788 | 8.90 | 8.85 | 0.0 |

| 51507 | 1.12 | Premium | G | I1 | 60.4 | 59.0 | 2383 | 6.71 | 6.67 | 0.0 |

z_median = diamonds.z.median

for i in diamonds.loc[diamonds.z==0].index:

diamonds.loc[i, 'z'] = diamonds.z.median()Si observamos otra vez la tabla con las descripciones estadísticas, veremos que hay valores muy extremos para z e y. Es muy dificil encontrar un diamante de más de 3 centimetros en cualquiera de las dimensiones, por lo que, si vemos esos valores, podemos estar seguros que se trata de errores en las mediciones. Como solo hay tres, la manera más apropiada es removerla de nuestro análisis.

diamonds.loc[(diamonds.y > 30) | (diamonds.z > 30)]| carat | cut | color | clarity | depth | table | price | x | y | z | |

|---|---|---|---|---|---|---|---|---|---|---|

| 24068 | 2.00 | Premium | H | SI2 | 58.9 | 57.0 | 12210 | 8.09 | 58.90 | 8.06 |

| 48411 | 0.51 | Very Good | E | VS1 | 61.8 | 54.7 | 1970 | 5.12 | 5.15 | 31.80 |

| 49190 | 0.51 | Ideal | E | VS1 | 61.8 | 55.0 | 2075 | 5.15 | 31.80 | 5.12 |

# removemos estos tres valores de nuestro dataset.

diamonds = diamonds.loc[~((diamonds.y > 30) | (diamonds.z > 30))]Analizando variables categóricas

One-hot encoding es una manera de representar los datos categóricos a valores binarios, indicando con un 1 si cierto atributo se encuentra dentro de la observación y 0 si no se encuentra. Pandas cuenta con el método get_dummies para este fin.

pd.get_dummies(diamonds['cut'], prefix='cut')| cut_Fair | cut_Good | cut_Ideal | cut_Premium | cut_Very Good | |

|---|---|---|---|---|---|

| 1 | 0 | 0 | 1 | 0 | 0 |

| 2 | 0 | 0 | 0 | 1 | 0 |

| 3 | 0 | 1 | 0 | 0 | 0 |

| 4 | 0 | 0 | 0 | 1 | 0 |

| 5 | 0 | 1 | 0 | 0 | 0 |

| ... | ... | ... | ... | ... | ... |

| 53936 | 0 | 0 | 1 | 0 | 0 |

| 53937 | 0 | 1 | 0 | 0 | 0 |

| 53938 | 0 | 0 | 0 | 0 | 1 |

| 53939 | 0 | 0 | 0 | 1 | 0 |

| 53940 | 0 | 0 | 1 | 0 | 0 |

53930 rows × 5 columns

Esto genera un nuevo DataFrame que contiene 5 columnas correspondientes a las 5 categorías dentro del atributo cut. Sin embargo, nosotros no necesitamos 5 columnas para representar 5 categorías, sino que basta con 4: Cuando todos los atributos sean ceros significa que el quinto atributo es el que está presente dentro de la observación y de esta manera evitamos la colinealidad. El método get_dummies cuenta con un argumento llamado drop_first para generar K-1 columnas que es lo que estamos buscando.

pd.get_dummies(diamonds['cut'], prefix='cut', drop_first=True)| cut_Good | cut_Ideal | cut_Premium | cut_Very Good | |

|---|---|---|---|---|

| 1 | 0 | 1 | 0 | 0 |

| 2 | 0 | 0 | 1 | 0 |

| 3 | 1 | 0 | 0 | 0 |

| 4 | 0 | 0 | 1 | 0 |

| 5 | 1 | 0 | 0 | 0 |

| ... | ... | ... | ... | ... |

| 53936 | 0 | 1 | 0 | 0 |

| 53937 | 1 | 0 | 0 | 0 |

| 53938 | 0 | 0 | 0 | 1 |

| 53939 | 0 | 0 | 1 | 0 |

| 53940 | 0 | 1 | 0 | 0 |

53930 rows × 4 columns

La variable _cutFair será la categoría base (categoría que sirve como referencia cuando los indicadores son ceros). Ahora realizamos un one-hot encoding para las otras dos variables categóricas que nos quedan y las agregamos al dataset principal.

diamonds = pd.concat([diamonds, pd.get_dummies(diamonds['cut'], prefix='cut', drop_first=True)], axis=1)

diamonds = pd.concat([diamonds, pd.get_dummies(diamonds['color'], prefix='color', drop_first=True)], axis=1)

diamonds = pd.concat([diamonds, pd.get_dummies(diamonds['clarity'], prefix='clarity', drop_first=True)], axis=1)diamonds.shape(53930, 27)

Tercera parte: Explorando el Dataset

En esta sección realizaremos un analisis exploratorio de nuestro dataset conocido como EDA. EDA es una combinación de tecnicas numéricas y de visualización que nos permite entender diferentes caracteristicas del dataset. Una forma de clasificar el tipo de analisis depende del número de variables involucradas en el analisis, como por ejemplo, la tecnica de analisis univariado (explorar una variable), bivariado (explorar dos variables) o multivariado (explorar más de dos variables). El objetivo de esta sección no es realizar analisis estadístico, si no que nos enfocaremos en la visualización e interpretación.

El proceso general de exploración puede ser como sigue a continuación:

- Cuando el dataset está más o menos listo para el análisis, comenzamos aplicando técnicas estándares para tener un conocimiento básico de las variables.

- Comenzamos a formarnos una hipótesis acerca de ciertos aspectos del dataset, dentro del contexto del problema.

- Aplicamos técnicas EDA para comenzar a confirmar o rechazar nuestra hipótesis y preconcebir algunas ideas.

- Empezaras a comprender el dataset. Nuevas ideas comenzarán a surgir.

- Aplicamos EDA nuevamente para intentar responder a esas preguntas. Ganaremos más entendimiento y nuevas preguntas comenzarán a surgir.

- Repetimos los procesis 4 y 5 algunas veces y paramos cuando nos sintamos comodos del entendimiento que obtuvimos y estamos ya seguros que podemos seguir con la fase del modelamiento.

EDA Univariado

El EDA univariado se aplica a una variable o atributo. Realizar un análisis exploratorio para cada variable por separado es siempre el primer paso y es en casi todos los casos una actividad mandatoria. Nuestro objetivo es entender cada variable individualmente en términos de valores típicos, variación, distribución, etc.

# importamos seaborn que se complementa con matplotlib para la exploración

import seaborn as sns# separamos las variables numéricas con las categóricas

numerical_features = ['price', 'carat', 'depth', 'table', 'x', 'y', 'z']

categorical_features = ['cut', 'color', 'clarity']EDA para variables numéricas

La primera aproximación que utilizaremos es un EDA numérico. Una buena herramienta para determinar la distribución de las variables numéricas es utilizando un histograma. Imaginemos una recta numérica donde están todas nuestras observaciones. Lo que hace el histográma es separar esta recta numérica en intervalos iguales llamados bins o contenedores. La altura del histograma (eje y) representa la cantidad de valores que se observar en un bin y así saber si los datos están distribuidos de una manera simétrica o sesgada, entre otras conclusiones.

Como vamos a realizar un histograma para cada variable numérica, vamos a encapsular código en una función para hacer el proceso más eficiente.

def desc_num_feature(feature_name, bins=30, edgecolor='k', **kwargs):

describe = diamonds[feature_name].describe().round(2)

data1 = [i for i in describe.index]

data2 = [str(i) for i in describe]

text = ('\n'.join([ a +': '+ b for a,b in zip(data1, data2)]))

fig, ax = plt.subplots(figsize=(8, 4))

diamonds[feature_name].hist(bins=bins, edgecolor=edgecolor, ax=ax, **kwargs)

ax.set_title(feature_name, size=15)

plt.figtext(.95, 0.25, text , fontsize=15)desc_num_feature('price')Creamos nuestro histograma con 30 bins, por lo que el tamaño de cada bin está dado por la resta entre el valor superior e inferior dividido por 30.

bin_size = (18823-326) / 30

bin_size16.5666666666667

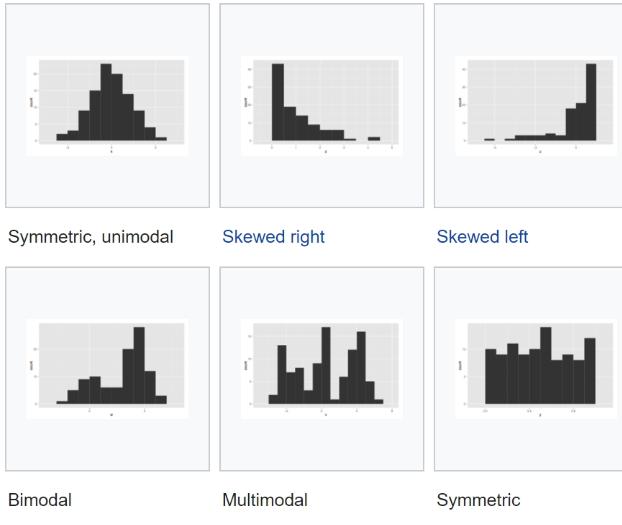

Podemos observar que en el primer bin, va entre un precio de 326 (minimo) a 943 (326 + 617). Entre esos precios vemos que hay aproximadamente 13.200 diamantes siendo el bin con el mayor número de observaciones (24% del total de datos aprox). Podemos observar también que entre mayor sea el precio, menos diamantes veremos. Esta distribución se le conoce como distribución sesgada a la derecha. Hay otros tipos de distribuciones comunes, como la distribución simétrica, modal y bimodal. En la siguiente imagen vemos algunas de ellas.

Un análisis numérico intenta explicar las distintas medidas de centralización, como la media, mediana y moda y las medidas de dispersión, como la desviación estándar, todo con el fin de entender más la distribución de los precios entre los distintos diamantes.

- Mientras el precio sube, se observan menos diamantes.

- Hay una alta variabilidad en los precios, reflejada en una desviación estándar de 4.000 dólares

- Por esta alta variabilidad en los precios y la larga cola de distribución, no hay tal cosa como un "diamante típico".

- En el primer cuarto de las observaciones el precio va entre 326 a 949,25, siendo un intervalo bien pequeño. No es raro por tanto encontrar diamantes menores a 1.000 dólares.

- Para un diamante que no es muy caro ni muy barato (25% a 75% de los datos) el rango de precio va entre los 950 y los 5.300 dólares.

- La mitad de los diamantes valen menos que 2.401 dólares.

- La distribución de los precios es distribución sesgada a la derecha. Esto tiene implicancias en la forma en que debemos realizar el modelado.

El mismo analisis se puede hacer para las demás variables. Veamos a continuación como se comportan.

for i in numerical_features:

desc_num_feature(i)1) carat:

- El peso del diamante tiene una distribución multinominal para las primeras observaciones y va formando una cola luego que el peso supere el quilate, siendo más una distribución sesgada a la derecha.

- Hay 1/4 de posibilidad de encontrarse con un diamante superior a un quilate y es raro encontrar diamantes superiores a dos quilates

- Solo 0,2 quilates hay de intervalo en el primer cuartil.

- Un diamante no tan liviano, pero tampoco tan pesado (primer a tercer cuartil) se encuentra entre 0,2 y 1,04 quilates.

- La desviación es alta, por lo que no hay un peso que sea tipico entre los diamantes.

2) depth:

- El porcentaje de profundidad total del diamante sigue una distribución normal, siendo la media con la mediana muy cercanos.

- Los valores se concentran mucho en el centro, pudiendo existir muchos valores atípicos. Esto lo podemos ver además del gráfico en los percentiles: El mínimo es 43 y entre el primer y tercer cuartil solo hay una diferencia de 1,5. El máximo es 79 lo que también deja mucha diferencia entre el primer y tercer cuartil.

- La desviación estándar es baja: los datos se concentran mucho en un solo lugar.

3) table:

- El ancho de la parte superior del diamante en relación con el punto más ancho sigue una distribución parecida a la variable anterior, solo que su desviación no es tan baja

4) x:

- El largo en mm tiene una distribución más simétrica, en el sentido de que el rango entre el primer y el tercer cuartil tiene mucha amplitud, pero los datos no parecen seguir un patrón de distribución

- Se observan pocas observaciones para diamantes muy largos y en general, las mayores observaciones están en menores largos.

5) y:

- El ancho sigue una distribución muy parecida al largo, siendo la muestra de diamantes similar en su ancho y largo.

6) z:

- La profundidad en cambio comienza en números más bajos (minimo en 1,07 mm) siendo extraño encontrar diamantes que su profundidad sea mayor a su ancho y largo.

- Hay una gran amplitud entre el minimo y el primer cuartil, siendo común encontrar diamantes con menos de 2 mm de profundidad.

- El promedio del diamante y la media son casi iguales, lo que da cuenta de que un diamante común tiene una profundidad de 3,5 mm.

- Los datos son simétricos, tomando en cuenta que la desviación es baja.

EDA para variables categóricas

La exploración por variables categóricas suele ser más fácil. Por lo general lo primero que queremos ver es la cantidad de observaciones que tenemos en cada categoría. Esto es util expresarlo como una proporción con respecto al total.

Por otro lado, así como el histograma es una visualización por defecto para las variables numéricas, el gráfico de barras es el gráfico utilizado por defecto para las variables categóricas.

def desc_cat_feature(index):

feature = categorical_features[index]

count = diamonds[feature].value_counts()

percent = 100 * diamonds[feature].value_counts(normalize=True)

df = pd.DataFrame({'count':count, 'percent':percent.round(1)})

print(df)

count.plot(kind='bar', title=feature)Veamos primero como se ve la distribución de variables categóricas para el corte.

desc_cat_feature(0)count percent Ideal 21549 40.0 Premium 13788 25.6 Very Good 12080 22.4 Good 4904 9.1 Fair 1609 3.0

Ahora, veremos la distribución para el color y la claridad.

desc_cat_feature(1)count percent G 11290 20.9 E 9795 18.2 F 9540 17.7 H 8301 15.4 D 6774 12.6 I 5422 10.1 J 2808 5.2

desc_cat_feature(2)count percent SI1 13065 24.2 VS2 12256 22.7 SI2 9190 17.0 VS1 8168 15.1 VVS2 5066 9.4 VVS1 3654 6.8 IF 1790 3.3 I1 741 1.4

Los gráficos de barra ya explican muy bien la información para cada variable categórica. Ahora tenemos una imagen más clara de qué categorías de diamantes son más y menos comunes para cada corte, color y claridad. Estamos ganando más entendimiento acerca del dataset.

EDA Bivariado

El EDA bivariado es utilizado para estudiar la relación entre dos variables y entender como están relacionadas entre si. La cantidad de pares de relaciones que obtendremos es (k(k-1))/2. En nuestro dataset original tenemos 10 variables, por tanto, esto corresponde a 45 pares de variables a analizar.

De todas formas, no necesitamos analizar todos los pares, solo los que nos interesan o los que podrían contestar una pregunta específica que puedas tener dentro de tu dataset.

Para explorar estas relaciones primero necesitamos saber qué tipo de variables tenemos, dado que tenemos tres posibilidades de comparación:

- Dos variables numéricas

- Dos variables categóricas

- Una variable numérica y otra variable categórica.

Para cada una hay visualizaciones estándares y calculos numéricos, pero puedes también aplicar creativamente otras formas de análisis. Que sea estándar no significa que no puedas innovar, pero las siguientes formas entregan suficiente información que podemos explorar.

Dos variables numéricas

El gráfico por excelencia para visualizar la relación entre dos variables numéricas es el diagrama de dispersión. Este gráfico basicamente ubica en un plano cartesiano las observaciones de dos variables, una ubicada en el eje x y la otra en el eje y.

Hay ciertas características que debemos considerar para poder interpretar correctamente un diagrama de dispersión. Estas son:

- Tendencia: Generalmente, tendremos una tendencia entre la relación de dos variables. Esta tendencia puede seguir una linealidad, una curva, exponencial o patrones más complicados.

- Fuerza/Ruido: Esto tiene que ver con cuanta claridad vemos la tendencia en la relación o que tan cerca los puntos siguen cierto patrón. También observaremos ruido en la forma de la desviación o dispersión entre los puntos, alrededor de la tendencia o el patrón promedio. Tendencias más fuertes muestran menos ruido y viceversa.

- Dirección: Si hay una relación entre las variables, notaremos hacia qué dirección va la tendencia. Esta puede ser positiva o negativa.

- Positiva: Ambas variables se mueven en la misma dirección: Mientras una variable crece, la otra también tiende a crecer y viceversa. En este caso, la tendencia va hacia arriba.

- Negativa: Las variables se mueven en direcciones diferentes: Si una crece, la otra tiende a decrecer y viceversa. En este caso, las variables tienden a ir hacia abajo.

En algunos casos las relaciones pueden ser positivas en algunos rangos y negativas en otros.

Veamos ahora algunos ejemplos

diamonds.plot.scatter(x='carat', y='price', s=.6)- Tendencia: Vemos que la relación sigue una tendencia no lineal, quizás una cuadrática o exponencial.

- Fuerza/Ruido: A pesar de que la tendencia se ve clara, hay mucho ruido en esta relación. Aunque podamos imaginar una curva que pasa entre medio de los puntos, hay mucha desviación en esa tendencia general.

- Dirección: A medida que el peso del diamante aumenta (carat), el precio también aumenta, por lo que podemos apreciar una relación directa.

La conclusión del gráfico es que carat definitivamente nos ayudará a predecir el precio del diamante, pero detectamos una tendencia no lineal, lo que será una importante consideración a la hora de crear el modelo.

Si no hubiese relación entre dos variables, el diagrama de dispersión podría verse como una nube de puntos: puro ruido sin una tendencia definida. Esto no siempre es así: también pueden existir otras formas además de una nube que no nos muestre relación alguna. A continuación un ejemplo de ello.

diamonds.plot.scatter(x='table', y='price', s=.6)Entre el precio y table (ancho de la parte superior del diamante en relación con el punto más ancho) no se ve ninguna relación. Realizaremos un zoom donde se encuentran la mayoria de los datos para ver si detectamos algún patrón.

diamonds.plot.scatter(x='table', y='price', s=.6, xlim=(50, 70))Nuevamente es dificil ver cualquier relación entre table y precio.

Estas relaciones de variables numéricas no es necesarias hacerlas una a una. Una forma eficiente de graficar todas las relaciones posibles es utilizando la librería seaborn para graficar lo que se conoce como una matriz de diagrama de dispersión, siendo posible visualizar muchas relaciones al mismo tiempo.

sns.pairplot(diamonds[numerical_features], plot_kws={'s':2})Esto resulta ser muy bonito, informativo y poderoso con una sola linea de código. Seaborn permite personalizar la diagonal de la matriz, por ejemplo, configurando el parámetro _diagkind="kde" en vez del histograma. El valor "kde" se refiere a la función de densidad de probabilidad que es una aproximación de la probabilidad de distribución para la variable. Veamos como se ve:

sns.pairplot(diamonds[numerical_features], plot_kws={'s':2}, diag_kind='kde')¿En qué atributos vemos una mayor relación con respecto al precio?

Con este método podemos apreciar de manera inmediata si hay un patrón o tendencia y que tan fuerte es.

- Precio con respecto a las dimensiones (x, y, z): Hay una relación más o menos logarítmica con las dimensiones de largo, ancho y profundidad, lo que significa que ha medida de que hay mayor longitud en una de las dimensiones, la derivada del precio va a un ritmo decreciente. Si el precio estuviese en el eje y, sería al revés (tendencia exponencial).

- Precio con table: Como vimos anteriormente, no se ve ninguna relación.

- Precio con depth: El porcentaje de la profundidad total tampoco muestra relación con el precio.

- Precio con peso del diamante: Se ve una relación exponencial si el precio está en el eje x o logaritmica si esta en el eje y.

Una forma de ver las relaciones entre todas las variables más rápidamente es a través de valores numéricos con el cálculo del coeficiente de correlación de Pearson. Hay otros coeficientes de correlación, pero este es el más popular. Este es un indicador numérico que indica que tan fuerte es la relación entre ellas. Los valores van entre 1 y -1.

- Si el coeficiente toma valores cercanos a -1 la correlación es fuerte e inversa y será tanto más fuerte cuanto más se aproxime a -1.

- Si el coeficiente toma valores cercanos a 1 la correlación es fuerte e directa y será tanto más fuerte cuanto más se aproxime a 1.

- Si el coeficiente toma valores cercanos a 0 la correlación es débil y será tanto más fuerte cuanto más se aproxime a 0.

Si es exactamente 1 o -1, los puntos de la nube están sobre la recta creciente o decreciente. Si es 0 no hay absolutamente ninguna relación.

Importante: Si no existe relación significa que no hay dependencia lineal, lo que no quiere decir de que pueda haber una dependencia en otro tipo de distribución que no sea lineal.

En Pandas existe un método llamado corr() que nos permite ver todas la relación entre todas las variables de una sola vez mostrandolas en una matriz de la siguiente manera:

diamonds[numerical_features].corr()| price | carat | depth | table | x | y | z | |

|---|---|---|---|---|---|---|---|

| price | 1.000000 | 0.921603 | -0.010595 | 0.127157 | 0.887216 | 0.888810 | 0.881682 |

| carat | 0.921603 | 1.000000 | 0.028317 | 0.181650 | 0.977761 | 0.976844 | 0.975969 |

| depth | -0.010595 | 0.028317 | 1.000000 | -0.295722 | -0.025020 | -0.028151 | 0.096719 |

| table | 0.127157 | 0.181650 | -0.295722 | 1.000000 | 0.196129 | 0.189964 | 0.155885 |

| x | 0.887216 | 0.977761 | -0.025020 | 0.196129 | 1.000000 | 0.998652 | 0.990743 |

| y | 0.888810 | 0.976844 | -0.028151 | 0.189964 | 0.998652 | 1.000000 | 0.990405 |

| z | 0.881682 | 0.975969 | 0.096719 | 0.155885 | 0.990743 | 0.990405 | 1.000000 |

Esto confirma lo que ya habiamos visto graficamente: el peso tiene una relación muy fuerte con el precio, mientras que table y depth tienen casi nula relación el precio. Esto quiere decir que estas variables no son muy informativas para indicarnos el precio del diamante.

Vemos por otro lado que las dimensiones (x, y, z) tienen una correlación muy alta con el precio (alrededor de 0,88). Esto quiere decir que entre más grande el diamante, hay altas posibilidades de que el diamante sea más caro. El peso es la que más relación tiene con el precio (0,92) como lo evidenciamos anteriormente.

Para una visión más agradable, podemos hacer un heatmap con seaborn. De esta forma con solo ver los colores podemos determinar que valores tienen una alta o una baja relación entre ellas.

plt.figure(figsize = (8, 6))

sns.heatmap(diamonds[numerical_features].corr(), annot=True, linewidths=.5)Ahora bien, observaremos más de cerca las variables que tienen una correlación más alta.

dim_features = diamonds[['carat', 'x', 'y', 'z']]

sns.pairplot(dim_features, plot_kws={'s':3})dim_features.corr()| carat | x | y | z | |

|---|---|---|---|---|

| carat | 1.000000 | 0.977761 | 0.976844 | 0.975969 |

| x | 0.977761 | 1.000000 | 0.998652 | 0.990743 |

| y | 0.976844 | 0.998652 | 1.000000 | 0.990405 |

| z | 0.975969 | 0.990743 | 0.990405 | 1.000000 |

Vemos que las correlaciones son extremadamente altas. Las dimensiones x, y, z se ven claramente lineales en los diagramas de dispersión. ¿Que quiere decir esto?

Básicamente, las tres variables contienen la misma información, en otras palabras, no son independientes. Sabiendo el valor de una podemos saber aproximandamente el valor de la otra. Este es un caso cercano a la colinealidad.

Por otro lado, la relación entre el peso (carat) se ve cuadrática y muy fuerte, que por supuesto tiene sentido: entre mayor sean sus medidas, mayor es su peso. Estas dependencias entre estas cuatro variables pueden ser muy problemáticas para algunos modelos, por lo que tendremos que hacer algo al respecto.

Dos variables categóricas

Para explorar las relaciones posibles entre dos variables categóricas también tenemos dos herramientas estándares: gráfico de barras y tablas cruzadas o tablas de contingencia

Tablas cruzadas

La tabla cruzada es simplemente una tabla con filas y columnas donde podemos ver el número de observaciones para cada combinación de categorías para dos variables categóricas. Podemos utilizar la función crosstab para lograr este cometido.

pd.crosstab(diamonds['cut'], diamonds['color'])| color | D | E | F | G | H | I | J |

|---|---|---|---|---|---|---|---|

| cut | |||||||

| Fair | 163 | 224 | 312 | 313 | 303 | 175 | 119 |

| Good | 662 | 933 | 907 | 871 | 702 | 522 | 307 |

| Ideal | 2834 | 3902 | 3826 | 4883 | 3115 | 2093 | 896 |

| Premium | 1602 | 2337 | 2331 | 2924 | 2358 | 1428 | 808 |

| Very Good | 1513 | 2399 | 2164 | 2299 | 1823 | 1204 | 678 |

Aqui vemos la cantidad que hay para cada una de las variables cruzadas, por ejemplo, vemos que hay 662 diamantes con cortes buenos y del mejor color. Sin embargo, con esta tabla por si sola es difícil detectar si hay alguna relación entre variables.

Probemos otra cosa: primero, calculemos los totales por cada columna y fila.

ct1 = pd.crosstab(diamonds['cut'], diamonds['color'], margins=True, margins_name='Total')

ct1| color | D | E | F | G | H | I | J | Total |

|---|---|---|---|---|---|---|---|---|

| cut | ||||||||

| Fair | 163 | 224 | 312 | 313 | 303 | 175 | 119 | 1609 |

| Good | 662 | 933 | 907 | 871 | 702 | 522 | 307 | 4904 |

| Ideal | 2834 | 3902 | 3826 | 4883 | 3115 | 2093 | 896 | 21549 |

| Premium | 1602 | 2337 | 2331 | 2924 | 2358 | 1428 | 808 | 13788 |

| Very Good | 1513 | 2399 | 2164 | 2299 | 1823 | 1204 | 678 | 12080 |

| Total | 6774 | 9795 | 9540 | 11290 | 8301 | 5422 | 2808 | 53930 |

Ahora, dividamos cada columna por el Total para ver como varía la proporción de cada diamante entre los colores y el corte. Si las proporciones son más o menos las mismas, podemos inferir de que no hay asociación entre estas variables. Esto significa que un diamante con buen corte, por ejemplo, no nos da información acerca de como será su color.

100 * ct1.div(ct1['Total'], axis=0).round(3)| color | D | E | F | G | H | I | J | Total |

|---|---|---|---|---|---|---|---|---|

| cut | ||||||||

| Fair | 10.1 | 13.9 | 19.4 | 19.5 | 18.8 | 10.9 | 7.4 | 100.0 |

| Good | 13.5 | 19.0 | 18.5 | 17.8 | 14.3 | 10.6 | 6.3 | 100.0 |

| Ideal | 13.2 | 18.1 | 17.8 | 22.7 | 14.5 | 9.7 | 4.2 | 100.0 |

| Premium | 11.6 | 16.9 | 16.9 | 21.2 | 17.1 | 10.4 | 5.9 | 100.0 |

| Very Good | 12.5 | 19.9 | 17.9 | 19.0 | 15.1 | 10.0 | 5.6 | 100.0 |

| Total | 12.6 | 18.2 | 17.7 | 20.9 | 15.4 | 10.1 | 5.2 | 100.0 |

La multiplicación por 100 fue solo hecha con la intensión de que sea más fácil la lectura de los números en porcentaje. La fila del Total indica la proporción promedio de los diferentes colores independiente del corte, por ejemplo, vemos que 12,6% de los colores son D. Esto se conoce como frecuencia marginal.

Estas frecuencias marginales nos dan una base comparativa con las frecuencias observadas para cada categoria de corte y así ver si hay desvaciones largas desde su frecuencia marginal.

Podemos ver desviaciones naturales, pero nada que se desvie mucho del promedio, lo que nos dice, por ejemplo, que un diamante de corte ideal no nos da información acerca de su color. Lo mismo pasa con las demás categorías de corte, lo que implica que hay poca o no hay asociación entre estas dos variables. Veamos las demás variables categóricas.

ct2 = pd.crosstab(diamonds['cut'], diamonds['clarity'], margins=True, margins_name='Total')

100 * ct2.div(ct2['Total'], axis=0).round(3)| clarity | I1 | IF | SI1 | SI2 | VS1 | VS2 | VVS1 | VVS2 | Total |

|---|---|---|---|---|---|---|---|---|---|

| cut | |||||||||

| Fair | 13.1 | 0.6 | 25.4 | 29.0 | 10.5 | 16.2 | 1.1 | 4.3 | 100.0 |

| Good | 2.0 | 1.4 | 31.8 | 22.0 | 13.2 | 19.9 | 3.8 | 5.8 | 100.0 |

| Ideal | 0.7 | 5.6 | 19.9 | 12.1 | 16.7 | 23.5 | 9.5 | 12.1 | 100.0 |

| Premium | 1.5 | 1.7 | 25.9 | 21.4 | 14.4 | 24.3 | 4.5 | 6.3 | 100.0 |

| Very Good | 0.7 | 2.2 | 26.8 | 17.4 | 14.7 | 21.4 | 6.5 | 10.2 | 100.0 |

| Total | 1.4 | 3.3 | 24.2 | 17.0 | 15.1 | 22.7 | 6.8 | 9.4 | 100.0 |

Aqui si vemos desvios importantes entre el corte y la frecuencia marginal de la claridad. Por ejemplo, para los cortes que son muy buenos, vemos más observaciones en la claridad a medida que vamos mejorando la calidad de esta misma, excepto por I1 que hay pocas observaciones quizás porque es dificil de llegar a esa calidad suprema de claridad. Veamos ahora que ocurre con las variables categóricas de claridad y color.

ct3 = pd.crosstab(diamonds['clarity'], diamonds['color'], margins=True, margins_name='Total')

100 * ct3.div(ct3['Total'], axis=0).round(3)| color | D | E | F | G | H | I | J | Total |

|---|---|---|---|---|---|---|---|---|

| clarity | ||||||||

| I1 | 5.7 | 13.8 | 19.3 | 20.2 | 21.9 | 12.4 | 6.7 | 100.0 |

| IF | 4.1 | 8.8 | 21.5 | 38.0 | 16.7 | 8.0 | 2.8 | 100.0 |

| SI1 | 15.9 | 18.6 | 16.3 | 15.1 | 17.4 | 10.9 | 5.7 | 100.0 |

| SI2 | 14.9 | 18.6 | 17.5 | 16.8 | 17.0 | 9.9 | 5.2 | 100.0 |

| VS1 | 8.6 | 15.7 | 16.7 | 26.3 | 14.3 | 11.8 | 6.6 | 100.0 |

| VS2 | 13.8 | 20.2 | 18.0 | 19.1 | 13.4 | 9.5 | 6.0 | 100.0 |

| VVS1 | 6.9 | 18.0 | 20.1 | 27.3 | 16.0 | 9.7 | 2.0 | 100.0 |

| VVS2 | 10.9 | 19.6 | 19.2 | 28.5 | 12.0 | 7.2 | 2.6 | 100.0 |

| Total | 12.6 | 18.2 | 17.7 | 20.9 | 15.4 | 10.1 | 5.2 | 100.0 |

En algunos colores la variación con respeto a la frecuencia marginal no es mucha, como por ejemplo, para el color E, F, H, I, J. Para los colores D y G se observa mayor variación, pero nada como para determinar una relación entre las variables de color y claridad.

Gráfico de barras

Puede resultar útil visualizar la cantidad proporcional entre dos categorías utilizando un gráfico de barras. Como vimos con las tablas cruzadas, hay algunas variaciones y podríamos tener una visión más clara viendolas en un gráfico que en una tabla.

basic_ct = pd.crosstab(diamonds['cut'], diamonds['color'])

basic_ct.plot(kind='bar')Podemos hacer otro tipo de gráfico para ver el número de observaciones por cada categoría de cut, junto con la composición de los diferentes colores. Este tipo de gráfico que se presenta a continuación se llama gráfico de barras apiladas

basic_ct.plot(kind='bar', stacked=True)Quizás para este caso, este tipo de gráfico no nos sea de mucha utilidad, dado que tenemos muchas categorías de colores. En otras ocasiones podría sernos de mayor utilidad.

Finalmente, veamos un gráfico de barras normalizado que es útil para comparar proporciones de colores, ignorando los números de diamantes en cada categoría de corte.

ct1.div(ct1['Total'], axis=0).iloc[:, :-1].plot(kind='bar', stacked=True)Como podemos ver, cada barra se ve más o menos parecida indicando que entre las variables de corte y de colores, no hay variaciones significativas. Veamos ahora las otras dos parejas para ver como se comportan.

ct2.div(ct2['Total'], axis=0).iloc[:, :-1].plot(kind='bar', stacked=True)Aqui podemos ver mayor variación, como habiamos mencionado anteriormente, en especial en la claridad SI2 y VS2. Al ver mayor variación, podriamos desarrollar la hipótesis que la claridad si nos puede brindar información acerca del color.

ct3.div(ct3['Total'], axis=0).iloc[:, :-1].plot(kind='bar', stacked=True)Para este caso, vemos mayores variaciones que el color y el corte, pero no significativamente mayor. Aún vemos que las proporciones son parecidas entre el color y la claridad, lo que significa que la claridad no nos brindaría información acerca del color, o en otras palabras, podríamos desarrollar la hipótesis de que estas variables no están relacionadas entre sí.

Una variable categórica y una variable numérica

Una de las visualizaciones estándares que se utilizan cuando tenemos una variable numérica y la otra categórica es el diagrama de caja o diagrama de bigote (boxplot) para comparar los efectos que tiene la media/mediana de variables numéricas en variables categóricas o viceversa.

Un boxplot es un gráfico que muestra mucha información sobre una variable: los tres cuartiles (Q1, Mediana y Q3) están representados como una caja y los extremos mínimos y máximos están representados con una línea o bigote. Para más información, dar clic aquí.

A continuación un ejemplo de un boxplot.

sns.boxplot(x='y', data=diamonds)Vamos a definir algunos conceptos importantes para entender un boxplot:

- Primer cuartil: Es el primer 25% de los datos. Es el costado izquierdo de la caja azul.

- Mediana o segundo cuartil: Es el 50% de los datos. Es la linea negra dentro de la caja azul.

- Tercer cuartil: Es el 75% de los datos. Es el costado derecho de la caja azul.

- Rango intercuartílico: Es la distancia de la caja azul, es decir, el tercer cuartil menos el primer cuartil.

- Barrera: Son las lineas verticales que están los extremos. La barrera superior es el tercer cuartil + 1,5 veces el rango intercuartílico y la barrera inferior es el primer cuartil - 1,5 veces el rango intercuartílico.

- Valores atípicos: Son aquellos puntos que están más allá de las barreras.

Considerar que los valores identificados en el boxplot como atípicos (outliers) son solo candidatos para ser atípicos. De hecho, el concepto de valores atipicos no está bien definido, dado que depende del contexto y de la distribución de las variables.

Si bien, los boxplot son utilizados para análisis de univariables, son mucho más utiles para análisis bivariables, porque ofrecen una manera simple de comparar distribuciones entre distintas variables categóricas. Veamos que sucede entre el corte del diamante y su precio.

sns.boxplot(x='cut', y='price', data=diamonds)Los boxplots se ven más o menos similares. Como la medida de la caja es una medida de spread, podemos ver que hay mayor variación de precio en la categoría premium. Se presenta también muchos valores atípicos en todas las categorias, pero esto es en escencia por la distribución de los precios. Enfoquemonos por ahora solo en los diamantes que cuestan más de 10.000 dólares.

sns.boxplot(x='cut', y='price', data=diamonds.loc[diamonds['price'] < 10000])Aqui podemos ver dos cosas claramente:

- La distribución del precio entre premium, good y very good son muy similares.

- La mayor diferencia entre la distribución de los precios se ve en las categorías fair e ideal. Para los diamantes con corte fair más de la mitad cuesta menos de USD 2.000, mientras que fair solo un 25% de los diamantes cuesta menos que USD 2.000.

Podemos concluir que defintivamente hay una relación entre los diferentes cortes y la distribución de precios.

Ahora, sabiendo que los precios tienen una distribución sesgada, veamos que tan diferentes son las medianas de los precios en cada categoría.

diamonds.groupby('cut')['price'].agg(np.median).sort_values()cut Ideal 1810 Very Good 2648 Good 3054 Premium 3183 Fair 3282 Name: price, dtype: int64

Efectivamente las medianas son muy distintas, en especial para las variables de ideal y fair. Realicemos el mismo ejercicio para la categoría clarity y utilizando las medianas en orden, graficaremos un boxplot para que podamos ver mejor las diferencias de la distribución del precio para cada categoría.

medians_by_clarity = diamonds.groupby('clarity')['price'].agg(np.median).sort_values()

print(medians_by_clarity)clarity IF 1080.0 VVS1 1092.5 VVS2 1311.0 VS1 2005.0 VS2 2053.0 SI1 2822.0 I1 3344.0 SI2 4072.0 Name: price, dtype: float64

sns.boxplot(x='clarity', y='price', data=diamonds.loc[diamonds['price']<10000], order=medians_by_clarity.index)Aqui vemos una relación muy clara: Hay una mayor concentración de precio (menor distribución o varianza) en los cortes de menor calidad y mayor distribución en los mejores cortes. Además que el precio de los mejores cortes tiene una mediana mayor a los de peor corte. Esto quiere decir que la variable corte si tiene una influencia significativa en el precio.

Por último, veamos la relación entre el precio y el color.

medians_by_color = diamonds.groupby('color')['price'].agg(np.median).sort_values()

sns.boxplot(x='color', y='price', data=diamonds.loc[diamonds['price']<10000], order=medians_by_color.index)Vemos que, al igual que el corte y precio, podemos ver dos grupos distintos que son parecidos entre si:

- Los colores E, D, G y F tienen precios muy similares. Ocurre lo mismo con los colores H, I y J solo que este último se encuentra un poco más alto.

- Vemos que los peores colores tienen más concentración en los precios, es decir, precios con menor distribución que los mejores colores.

En conclusión podemos decir que si hay influencia del color sobre el precio de un diamante.

EDA Multivariado

Una exploración multivariable explora más de dos variables. Al igual que los otros tipos de exploración, hay formas comunes de trabajar con multivariables, como por ejemplo:

- Colorear un scatterplot para representar una variable categórica.

- Utilizar otra variable categórica en los boxplot

- Utilizar gráficos de celosía para dividir el análisis en diferentes categorías

- Gráficos paralelos.

- Mapas de calor (heatmaps)

Cuarta parte: Implementación de modelos

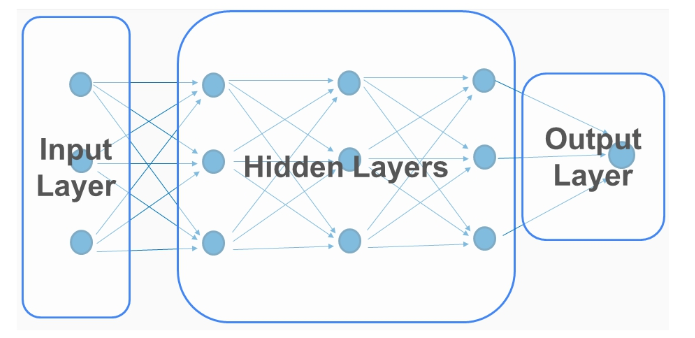

Machine Learning es la tecnología utilizada para crear proyectos predictivos. Puede definirse como un subcampo de la ciencia de la computación y es el área de la inteligencia artifial que estudia los métodos para utilizar datos y entregar la habilidad al computador de aprender de esos datos y realizar tareas sin programarlo explicitamente. Tipicamente ML está dividida en tres grandes áreas:

1) Aprendizaje supervisado: Es cuando el computador tiene algunos inputs asociados a un output y el sistema aprende como esos inputs producen tal output. Eso quiere decir que tenemos que definir tanto el input como el output.

2) Aprendizaje no supervisado: En este caso, no hay señal de guia para que el sistema pueda aprender. Este tipo de aprendizaje están generalmente enfocados en aprender algún tipo de estructura en la data, es decir, descubrir patrones ocultos en los datos. Algunas aplicaciones para este tipo de aprendizaje son los clustering, reducción de dimensionalidad, sistemas de recomendación, etc.

3) Aprendizaje por refuerzo: En este tipo de tareas, el aprendizaje ocurre como consecuencia de un sistema de computación que en este contexto es llamado "agente" que interactua con el ambiente. Los feedback que el sistema recibe son frecuentemente dados en la forma de castigo o recompensa. Las aplicaciones que se utilizan para este tipo de aprendizaje incluyen autos autónomos, robótica, algoritmos de trading y mucho más.

Para predecir el precio del diamante utilizaremos un aprendizaje supervisado, dado que tenemos los inputs y definimos el output, que es el precio. En un aprendizaje supervisado tenemos dos tipos de tareas:

- Regresión: Es utilizada cuando la variable objetivo es numérica. Por ejemplo, predecir el precio de casas, número de personas realizando clic en un anuncio, proporción de crimenes, precios de acciones, etc.

- Clasificación: Es utilizada cuando la variable objetivo es categórica. Ejemplos de clasificación está en todas partes: Si un cliente compra o no, si un paciente está sano o no, etc. Hay principalmente tres tipos de problemas de clasificación:

- Clasificación binaria: La variable objetivo tiene solo dos categorías.

- Clasificación multiclase: La variable objetivo tiene más de dos categorías.

- Clasificación multietiqueta: El problema de asignar más de una categoría o etiqueta a una observación, por ejemplo, predecir el topico de un nuevo articulo basado en su contenido. Muchos articulos no caen en una sola categoría, porque un articulo puede ser simultaneamente acerca de noticias mundiales, politica y finanzas.

Técnicamente, un modelo de ML es una combinación de dos cosas:

1) Conjunto de hipótesis: Es una propuesta de como vamos a representar la conexión entre los valores de los atributos para producir los valores del vector objetivo. Es una función matemática que muestra la relación entre los inputs y el output.

2) Algoritmo de aprendizaje: Es un procedimiento que utiliza los datos para seleccionar un elemento de un conjunto de hipótesis. El elemento seleccionado es lo que las personas llaman un modelo. Entrenar un modelo significa usar el algoritmo de aprendizaje para seleccionar el modelo de un conjunto de hipótesis.

Conjunto de hipótesis

La propuesta de la relación entre los atributos y el vector objetivo será la siguiente para la data de diamantes.

price = w x carat donde w es cualquier número positivo.

Este modelo básicamente predice el precio multiplicando w por el valor de carat. Por ejemplo:

- price = 3 * carat

- price = 658.1 * carat

- price = 2535 * catat

Como w puede tomar cualquier valor, tenemos infinitos elementos en nuestro conjunto de hipótesis. ¿Como seleccionamos solo un elemento?

Algoritmo de aprendizaje

Para obtener un valor w de las infinitas posibilidades, dividiremos el precio por el carat correspondiente y promediaremos el resultado. Implementando este simple algoritmo es lo que nosotros llamaremos entrenar el modelo.

w = np.mean(diamonds['price']/diamonds['carat'])

w4008.0243030179727

Ya tenemos entonces el valor de nuestro w para utilizarlo en nuestro modelo propuesto, es decir, el modelo está dado por precio = 4008.024 carat. Ahora podremos usarlo para realizar predicciones de precio.

def first_ml_model(carat):

return 4008.024 * caratcarat_values = np.arange(0.5, 5.5, 0.5)

preds = first_ml_model(carat_values)

pd.DataFrame({'Carat':carat_values, 'Predicted price':preds})| Carat | Predicted price | |

|---|---|---|

| 0 | 0.5 | 2004.012 |

| 1 | 1.0 | 4008.024 |

| 2 | 1.5 | 6012.036 |

| 3 | 2.0 | 8016.048 |

| 4 | 2.5 | 10020.060 |

| 5 | 3.0 | 12024.072 |

| 6 | 3.5 | 14028.084 |

| 7 | 4.0 | 16032.096 |

| 8 | 4.5 | 18036.108 |

| 9 | 5.0 | 20040.120 |

Recordar que el proceso de análisis predictivo es utilizar métodos cuantitativos que utilizan los datos con el fin de realizar predicciones. Esto fue exactamente lo que hicimos, aunque solo fue una aproximación para hacer entender como es un modelo, porque en realidad el modelo que hicimos es horrible para predecir los precios de diamantes. Los modelos formalmente utilizados en ML llevan decadas de investigación y tienen un nivel de complejidad bastante alto, en contraste con el modelo que construimos. Muchos de estos modelos formales se encuentran ya implementados en una librería llamada scikit-learn.

Objetivos de un modelo ML

En el análisis predictivo, lo que nos gustaría hacer es predecir eventos desconocidos. Cuando utilizamos ML lo que hacemos es utilizar los datos y descubrir como las variables están relacionadas al vector objetivo. De hecho, eso es lo que los modelos ML intentan descubrir: suponemos que hay una función desconocida que toma las variables y realiza ciertos calculos para intentar imitar en lo posible el valor del vector objetivo. Si ya conocemos la función no tiene ningún sentido usar un modelo.

Una vez de que tengamos una función, podremos ingresar nuevos diamantes que estén fuera de los datos utilizados y podremos llegar a su precio aproximado.

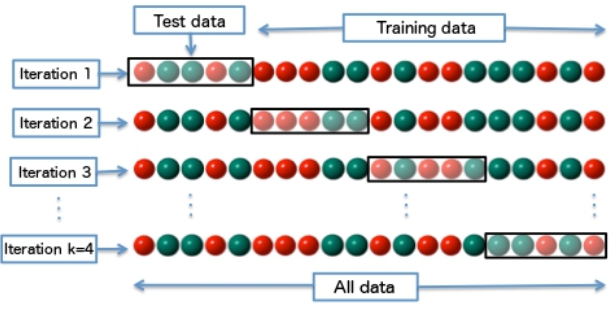

Una vez que tengamos listo el modelo, sería poco productivo esperar a que nos llegue un diamante para ver qué precio predice nuestro modelo y luego esperar a que sea vendido de tal manera de descubrir que tan buena fue nuestra predicción. Lo que queremos hacer es simular esa situación: necesitamos dividir las partes para que uno haga el trabajo de descubrir la función matemática para llegar al precio (el modelo) y la otra pueda descubrir si los resultados nos permiten realizar buenos negocios (vendedor). La forma de simular este escenario es a través del cross-validation que es un método para dividir un dataset en diferentes subsets con el fin de dar una mejor estimación de como el modelo va a generar los datos fuera de la muestra. La forma más simple de un cross-validation es el método hold-out que consiste en dividir nuestros datos en dos muestras: entrenamiento (buscar la función) y el test (probar el modelo).

- Conjunto de entrenamiento: Aquí es donde ocurre el aprendizaje, donde intentamos llegar a una función matemática que pueda predecir correctamente el vector objetivo

- Conjunto de test: Aquí es donde ocurre la evaluación del modelo ya entrenado. Estos datos se prueban como si fuesen datos nuevos que están fuera del contexto del entrenamiento, es decir, los algoritmos de entrenamiento no vieron estos datos. Qué tan bien el modelo pudo predecir los precios en el conjunto de test es un indicador de qué tan bien lo hará con nuevos datos, que tan generalizado está el aprendizaje.

Sobreajuste (overfitting)

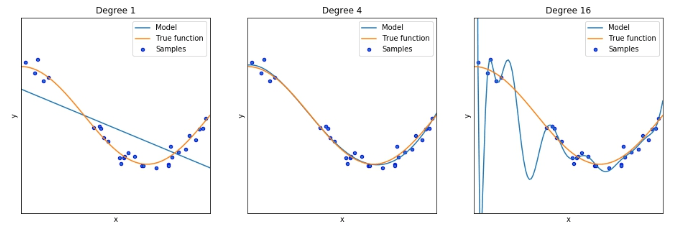

Muy conectado con el objetivo de que nuestro modelo sea generalizado, tenemos el concepto de overfitting. Esto es una situación donde el modelo se adapta tan bien al conjunto de entrenamiento que empieza a aprender del ruido que no está relacionado con la verdadera relación entre las variables y el vector objetivo. Hay distintos tipos de ajustes y estos son:

- Underfitting: Ilustrado en el lado izquierdo de la imagen, el underfitting es cuando intentamos utilizar un modelo muy simple para el problema, por ejemplo, un modelo lineal para capturar una relación o función no lineal entre una variable independiente y dependiente. Esta aproximación no permitirá predecir nuevas observaciones de manera precisa.

- Buen aprendizaje: Esta es la situación perfecta. Es cuando nuestro modelo tiene el mismo nivel de complejidad que el problema y da como resultado una buena aproximación a la verdadera función. Por ejemplo, en la imagen del centro el modelo para un polinomio con 4 grados lo hará muy bien.

- Overfitting: En esta situación implementamos un modelo muy complejo cuando el modelo no necesitaba tanta complejidad para ser resuelto (no matas a una mosca con una bazuca). Esto afecta la habilidad de aproximar bien la verdadera función y tendremos problemas con la generalidad de nuestro modelo, vale decir, que actue bien con nuevas observaciones. El principal síntoma del overfitting es que el rendimiento del modelo en el conjunto de entrenamiento es muy bueno, pero el rendimiento en el conjunto de testing es malo.

La regularización es una serie de técnicas que nos permitirán evitar el overfitting. Algunos modelos, como la regresión lasso o la regresión ridge son definidos como elementos regularizadores que intentarán evitar el overfitting.

Evaluación de la función y optimización

Todos los modelos ML tienen una función de evaluación que básicamente es una función matemática que asigna un número a cada elemento del conjunto de hipótesis. Esto con el fin de evaluar qué tan bueno es el modelo en predecir la variable objetivo. Esta función por tanto es usada para distinguir entre los buenos modelos y los malos modelos y además otorga información para buscar buenos modelos. La búsqueda de un buen modelo dentro del conjunto de hipótesis es usualmente realizado con la ayuda de técnicas de optimización.

Una buena técnica de optimización es vital para un eficiente aprendizaje del algoritmo. Por ejemplo, el algoritmo de aprendizaje puede escoger el modelo que minimize la función de evaluación. Nuestro primer modelo, sin embargo, no cuenta con una función de evaluación y una técnica de optimización.

Para tener estas variables en cuenta

Para tener en consideración todo lo anterior, utilizaremos una librería llamada scikit-learn. Esta librería es más que una librería para construir modelos ML. Es más bien un kit con un montón de herramientas útiles para la tarea de construir un modelo. Además de la implementación de los más variados y usados algoritmos de ML, ofrece herramientas para tareas relacionadas, como:

- Selección de modelos.

- Evaluación de modelos.

- Transformación de Datasets.

- Descarga de utilidades para los datasets.

Transformaciones

Recordar que diferentes modelos pueden verse afectados en diferentes maneras dependiente de como le entregamos la data al modelo. Las transformaciones son vitales en ese sentido. Las tranformaciones como suavizar la asimetría de los predictores u ocuparse de los datos atípicos pueden ser muy beneficios para que el modelo pueda aprender. Para obtener la data lista para el modelo hay dos aproximaciones:

- Preprocesamiento no supervisado involucra técnicas que no consideran al vector objetivo.

- Preprocesamiento supervisado que involucra técnicas que sí consideran al vector objetivo.

Algo importante a considerar es que scikit-learn no acepta variables categóricas. Dado que todo el cálculo para encontrar el mejor modelo es puramente matemático no podemos trabajar sin números. Esto es otra buena razón para utilizar one-hot encoding para no dejar atrás las variables categóricas que nos pueden brindar información muy importante para el modelo. Como la información de variables categóricas ya está realizada en nuevas columnas one-hot encoding, las columnas originales no serán incluidas al modelo.

Dejaremos una matriz llamada "x" para las variables input e "y" para la variable output o variable objetivo.

X = diamonds.drop(['cut', 'color', 'clarity', 'price'], axis=1)

y = diamonds['price']Train-Test Split

Esta etapa no es exactactamente una transformación de datos, pero es lo primero que debemos hacer antes de modelar. Aqui separaremos los datos en un conjunto de entrenamiento y de test. Recordar que el conjunto de test es como si fueran datos nuevos que están fuera de los datos de entrenamiento, por lo tanto cualquier transformación que hagamos antes de entrenar el modelo debe ser realizado al conjunto de entrenamiento y no al conjunto de test. Esta es la razón por la que debemos separar primero los datos.

La separación comunmente se hace con un 80% al conjunto de entrenamiento y 20% al conjunto de test. Esta participación más bien es como un hábito y tiene sentido cuando tenemos muestras pequeñas (menos de 1.000 observaciones) con el fin de tener datos suficientes para que el algoritmo aprenda. Sin embargo, si tenemos un dataset muy grande, es mejor pensar cuánto podría ser la mejor partición.

Entre más datos tenemos para entrenar, mejor. De hecho, algoritmos simples con muchos datos funcionan mejor que los algoritmos complejos con pocos datos, por lo que es importante mantener la mayor cantidad de datos que podamos en el conjunto de entrenamiento. Si por ejemplo, tenemos 5 millones de observaciones, no necesitamos el 20% para evaluarlo, porque un millón de observaciones es demasiado. En este caso, tener 1-2% en el conjunto de test tiene mucho más sentido.

Para el caso de este ejercicio, utilizaremos una separación de 90-10.

# importamos las librerías que necesitamos para esta cuarta parte.

from sklearn.model_selection import train_test_split# separamos la data en conjunto de entrenamiento y de test.

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=.1, random_state=123)Internamente, la función train_test_split realiza la repartición de datos de manera aleatoria. Con random_state podemos generar una repartición aleatoria que nos da las mismas observaciones para cada conjunto cada vez que ejecutamos la línea anterior.

Reducción de la dimensionalidad con PCA

La reducción de la dimensionalidad es un procedimiento que toma una lista de variables y las reduce. El fin de esto es preservar la mayor cantidad de información de la base original, pero quitando aquellas variables que producen colinealidad, como vimos con las variables x, y, z (escencialmente tienen la misma información). Extraemos más información, pero nos quedamos con la más importante para poder predecir el vector objetivo. Si le pasamos muchas variables al modelo, el rendimiento no suele ser tan buenos.

La técnica de reducción de dimensionalidad más popular es el análisis de componentes principales o PCA (principal component analysis). Este algoritmo utiliza el algebra lineal para transformar las variables originales a otro set de variables que están linealmente correlacionadas, lo que es llamado componentes principales (PC). El primer PC es el que captura la mayor información de todas las variables, el segundo PC captura la mayor información faltante después de considerar el primer PC, el tercer PC captura la mayor información faltante después de considerar el primer y segundo PC y así consecutivamente. Debemos decidir cuántos de estos PC utilizaremos para reducir la dimensionalidad del dataset original.

Antes de implementar esta reducción, denemos de introducir el concepto de transformadores (transformers en inglés) que son clases de scikit-learn para realizar preparaciones de datos. Para usar transformadores siempre debemos seguir estos pasos: 1) Importar la clase que vamos a utilizar. 2) Crear una instancia de la clase aplicando parámetros adicionales. 3) Utilizar el método fit en la instancia. Este método ejecutará los cálculos internos necesarios para el siguiente paso. 4) Utilizar el método transform para realizar las transformaciones.

La clase PCA es un transformador, por lo que apliquemos los pasos anteriores en código.

# Importar la clase que vamos a utilizar.

from sklearn.decomposition import PCA

# Crear una instancia de la clase.

pca = PCA(n_components=3, random_state=123)

# Utilizar el método fit en la instancia.

pca.fit(X_train[['x', 'y', 'z']])

# Utilizar el método transform para realizar las transformaciones.

princ_comp = pca.transform(X_train[['x', 'y', 'z']])Utilizando este método, podemos verificar, en términos de proporción, cuánta varianza (o información) es capturada en cada uno de los componentes producidos.

pca.explained_variance_ratio_.round(3)array([0.997, 0.002, 0.001])

99,7% de la varianza de los tres componentes originales es capturada por el primer componente principal, del resto, es capturado mayoritariamente por el segundo componente y el tercero no se lleva casi nada. Dado esos resultados, es buena idea preservar solo el primer PC. Antes de producir esta nueva variable, veamos como los tres principales componentes están en realidad no correlacionados entre sí.

princ_comp = pd.DataFrame(data=princ_comp, columns=['pc1', 'pc2', 'pc3'])

sns.pairplot(princ_comp, plot_kws={'s':3})princ_comp.corr().round(4)| pc1 | pc2 | pc3 | |

|---|---|---|---|

| pc1 | 1.0 | -0.0 | 0.0 |

| pc2 | -0.0 | 1.0 | 0.0 |

| pc3 | 0.0 | 0.0 | 1.0 |

Como vemos, todas las correlaciones son 0, es decir, no hay absolutamente ninguna relación entre ellas. Como sabemos que vamos a preservar solo el primer componente, ejecutemos el mismo código, pero utilizamos n_components=1. Luego, añadiremos esta nueva variable en el dataset y eliminaremos las variables x, y, z.

# Obtenemos solo el primer componente principal

pca = PCA(n_components=1, random_state=123)

# Entrenamos el transformador pca

pca.fit(X_train.loc[:, ['x', 'y', 'z']])

# Añadimos la nueva variable al dataset

X_train['dim_index'] = pca.transform(X_train.loc[:, ['x', 'y', 'z']]).flatten()

# Eliminamos las variables x, y, z

X_train.drop(['x', 'y', 'z'], axis=1, inplace=True)Con esto pudimos reducir las tres variables x, y, z en una sola. Ahora estamos listos para el siguiente paso.

Unidad tipificada y ajuste

La estandarización es quizás la forma más común de transformación para preparar los datos al modelo. Aunque, muchos algoritmos pueden aprender igual de bien sin aplicar esta transformación, mejorará la estabilidad numérica y la velocidad de ejecución para la mayor parte de los algoritmos, y muchos de ellos, como KNN, requieren este paso para agregar respuestas sensibles. Hay distintas formas de realizar esta estandarización y una de ellas involucra a scikit-learn.

Por cada valor numérica substraemos el promedio (el nuevo promedio es cero) y dividimos cada valor por su desviación estándar. Después de eso, todas las variables tendrán un promedio de cero y una desviación estándar o varianza de 1, por lo que los datos estarán en la misma escala.

numerical_features = ['carat', 'depth', 'table', 'dim_index']

# Importamos la clase que utilizaremos

from sklearn.preprocessing import StandardScaler

# Creamos una instancia de la clase

scaler = StandardScaler()

# Utilizamos un método fit para la instancia

scaler.fit(X_train[numerical_features])

# Usamos el método transform para realizar la transformación

X_train.loc[:, numerical_features] = scaler.transform(X_train[numerical_features])X_train[numerical_features].head()| carat | depth | table | dim_index | |

|---|---|---|---|---|

| 30067 | -0.840293 | 1.429309 | -0.205642 | -0.918737 |

| 17609 | 0.677534 | 0.383359 | -2.001069 | 0.848778 |

| 42509 | -0.629484 | 0.034709 | -0.205642 | -0.568903 |

| 22843 | 0.719696 | -0.662591 | 0.243215 | 0.908909 |

| 25958 | 2.553737 | -1.987460 | 2.487499 | 2.147705 |

En este output vemos como las variables numéricas están estandarizadas, es decir, a la misma escala.

Finalmente, ejecutando la siguiente línea de código, podemos rapidamente notar que el promedio y la desviación estándar son practicamente 0 y 1, respectivamente.

X_train[numerical_features].describe().round(4)| carat | depth | table | dim_index | |

|---|---|---|---|---|

| count | 48537.0000 | 48537.0000 | 48537.0000 | 48537.0000 |

| mean | -0.0000 | -0.0000 | -0.0000 | 0.0000 |

| std | 1.0000 | 1.0000 | 1.0000 | 1.0000 |

| min | -1.2619 | -13.0745 | -6.4896 | -1.8152 |

| 25% | -0.8403 | -0.5231 | -0.6545 | -0.9077 |

| 50% | -0.2079 | 0.0347 | -0.2056 | -0.0236 |

| 75% | 0.5089 | 0.5228 | 0.6921 | 0.7114 |

| max | 8.8780 | 12.0283 | 9.6692 | 4.4959 |

A partir de este punto es importante no realizar nuevas transformaciones, porque de lo contrario, las variables no estarán estandarizadas. Es por esto que esta debe ser nuestra última transformación antes de comenzar con la implementación del modelo.

Modelos de regresión

En scikit-learn los modelos ML son implementados en clases conocidos como estimadores, donde incluyen objetos que aprender de los datos, principalmente modelos y transformadores. Todos los estimadores tienen un método fit que es utilizado para entrenar el estimador de la siguiente manera: estimador.fit(data).

Es importante considerar que el estimador tiene dos tipos de parámetros:

Parámetros del estimador: Todos los parámetros de un estimador pueden ser establecidos en una instancia. Algunos de estos parámetros corresponden a hiperparámetros.

Parámetros estimados: Cuando la data es "equipada" a un estimador, los parámetros son estimados desde los datos a mano. Todos los parámetros son atributos del objeto estimado y se reflejan terminando con un guión bajo.

Como sckikit-learn tiene un API muy consistente utilizando estimadores, es muy similar a usar transformaciones. Para usar estimadores siempre se siguien los siguientes cuatro pasos:

1) Importar la clase del estimador que usaremos.

2) Creamos una instancia de la clase. Aquí podremos incorporar algunos parámetros adicionales, algunos de ellos como hiperparámetros.

3) Usar el método fit de la instancia para entrenar el modelo.

4) Usar el método predit para obtener predicciones.

Regresión Líneal

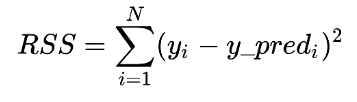

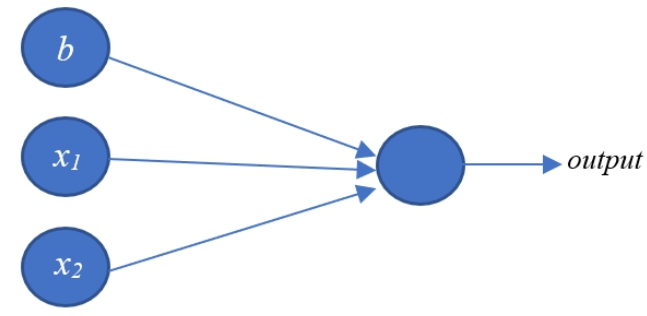

Implementaremos primero un modelo de regresión lineal, siendo el modelo más simple de entender. Para este modelo lo que realiza el algoritmo de aprendizaje (llamado OLS o ordinary least squares) es identificar la mejor combinación de linealidad entre dos variables para que la suma residual de cuadrados (RSS) sea minima.

N es el número de puntos en el conjunto de entrenamineto, y_pred son los valores predichos e "y" representa el valor actual del vector objetivo. El algoritmo hace que el RSS sea el mínimo posible. Ahora si realizaremos la aplicación de una regresión lineal utilizando scikit-learn.

# Importamos las clases del estimador que usaremos.

from sklearn.linear_model import LinearRegression

# Creamos una instancia de la clase.

ml_reg = LinearRegression()

# Utilizaremos el método fit() en la instancia.

ml_reg.fit(X_train, y_train)

# Utilizaremos el método predict() para obtener las predicciones

y_pred_ml_reg = ml_reg.predict(X_train)El modelo ya fue entrenado en el conjunto de entrenamiento y las predicciones del conjunto de test han sido calculadas. Miremos primero como quedaron los coeficientes de la función lineal.

Recordar que la estructura básica de una regresión lineal es y = coeficiente*X +- constante

pd.Series(ml_reg.coef_, index=X_train.columns).sort_values(ascending=False).round(2)carat 5421.98 clarity_IF 5385.94 clarity_VVS1 5041.23 clarity_VVS2 4994.61 clarity_VS1 4617.94 clarity_VS2 4304.01 clarity_SI1 3705.83 clarity_SI2 2741.17 cut_Ideal 856.14 cut_Premium 756.61 cut_Very Good 756.06 cut_Good 609.45 table -59.00 depth -80.62 color_E -217.07 color_F -276.78 color_G -489.77 color_H -991.08 dim_index -1235.17 color_I -1480.43 color_J -2384.28 dtype: float64

Estos números son los coeficientes que se multiplican por cada variable en nuestro modelo. El hecho de que las variables estén en la misma escala, podemos interpretar los coeficientes como medida de variable de importancia. Por ejemplo, carat y clarity se ven como las variables que tienen una mayor influencia sobre el precio. El signo del coeficiente nos dice algo acerca de la dirección en la relación entre la variable y el precio: un signo positivo es un impacto positivo en el precio y un signo negativo es un impacto negativo.

El resultado e interpretación que estamos haciendo solo tiene sentido bajo el modelo que estamos implementando y bajo las variables que usamos. Si quitamos una variable obtendremos coeficientes diferentes.

from sklearn.base import clone

ml_reg1 = clone(ml_reg)

ml_reg1.fit(X_train.drop('carat', axis=1), y_train)

pd.Series(ml_reg1.coef_, index=X_train.drop('carat', axis=1).columns).sort_values(ascending=False).round(2)clarity_IF 5145.24 clarity_VVS1 4787.16 clarity_VVS2 4595.47 dim_index 4037.23 clarity_VS1 4002.79 clarity_VS2 3707.79 clarity_SI1 2972.60 clarity_SI2 2207.40 cut_Premium 935.20 cut_Ideal 923.39 cut_Very Good 812.14 cut_Good 608.70 depth 136.87 table -6.30 color_E -212.56 color_F -361.50 color_G -503.15 color_H -814.71 color_I -1112.21 color_J -1876.54 dtype: float64

Como podemos ver, el cambio más notorio es con _dimindex donde su coeficiente fue de positivo a negativo. Lo que ocurre aqui es que carat es extrechamente ligado a dim_index y cuando los dos están juntos en el modelo, la mejor forma que tiene el algoritmo de usar la información contenido en ambas variables fue asignar un coeficiente alto en carat y un pequeño coeficiente negativo en dim_index. Cuando carat es eliminado, la mejor forma de usar la información contenida dentro de dim_index fue asignarle un alto coeficiente positivo.

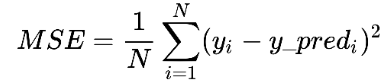

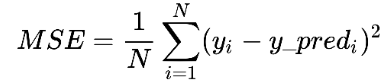

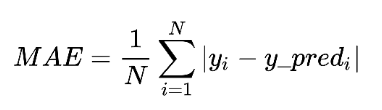

Ahora es tiempo de examinar qué tan bien le fue al modelo con las predicciones. Para esto, necesitamos una métrica, es decir, una función que tomará los valores predichos y los comparará con los verdaderos valores dentro del conjunto de test. La métrica más utilizada para este fin en los modelos de regresión es probablemente el error cuadrático medio (MSE en inglés).

El MSE es el promedio de la diferencia al cuadrado entre el valor real y el predicho. Entre menor valor es el MSE, mejor es el modelo. A continuación evaluemos como nos fue.

from sklearn.metrics import mean_squared_error

mse_ml_reg = mean_squared_error(y_true=y_train, y_pred=y_pred_ml_reg)

print('{:0.2f} M'.format(mse_ml_reg/1e6))1.28 M

El resultado son 1.28 millones, pero ¿es este número grande o chico? Necesitamos un punto de referencia para poder compararlo. Para obtener este punto de referencia, tratemos de resolver la siguiente pregunta: En la ausencia de cualquier información acerca de las caracteristicas de los diamantes, ¿cuál sería tu mejor conjetura del precio?. La conjetura que minimiza el MSE es conjeturar el promedio. Prediciendo que todos los valores del vector objetivo son iguales al promedio es llamado el modelo nulo, un modelo sin predictores. El rendimiento de este modelo nulo es el primer punto de referencia que podemos usar para compararlo con el rendimiento del modelo. Calculemos entonces el MSE para un modelo nulo:

y_pred_null_model = np.full(y_train.shape, y_train.mean())

mse_null_model = mean_squared_error(y_true=y_train, y_pred=y_pred_null_model)

mse_null_model15923703.431632007

Notar que solo utilizamos los valores del conjunto de entrenamiento para obtener el promedio. Obtenemos un MSE de casi 16 millones por lo que, en ausencia de cualquier información, nuestra mejor conjetura (promedio) nos dará un MSE de 15.9 millones, mientras que nuestro modelo que utiliza información de las variables, nos da 1.28 millones. Ahora tenemos algo de perspectiva acerca de este número y podemos decir que al menos nuestro modelo funciona mucho mejor que si adivinaramos el promedio del precio, lo que es genial para nuestro primero modelo ML.

Regresión Lasso

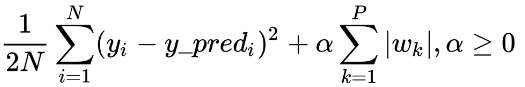

Lasso es una modificación utilizada para multiples modelos de regresiones. Este algoritmo automáticamente excluye aquellas variables que aportan poco a la precisión (accuracy) del modelo. La ecuación que usa la regresión lasso para realizar predicciones es la misma que el caso de la regresión líneal: una combinación lineal de todas las variables, es decir, cada una de ellas multiplicadas por un coeficiente. La modificación es realizada por la cantidad que el algoritmo está intentando minimizar. Esto quiere decir que si tenemos un predictor P el problema es encontrar una combinación de coeficiente que minimizará la siguiente cantidad:

La primera parte de la formula es casi igual al MSE, salvo que lo multiplicamos por 1/2. El cambio clave es en el segundo termino, que es la sumatoria del valor absoluto entre los coeficientes multiplicados por un valor no-negativo que llamaremos alpha que vendría siendo el coeficiente de regularización.

La idea detrás de este modelo es que, añadiendo un "castigo" en el valor absoluto del coeficiente, el algoritmo de aprendizaje contrae algunos coeficientes para que su valor sea cero, por tanto, eliminando la variable correspondiente para que no sea considerada para la predicción. Para valores más largos de alpha, el modelo asignará ceros a más coeficientes y por tanto más variables quedarán fuera del modelo.

Este modelo es muy util cuando tenemos decenas o cientos de variables, pero nos interesa seleccionar solo algunas de ellas que si contribuyan a la predicción. Como en nuestro problema tenemos pocas variables, no es recomendable utilizar la regresión Lasso en este problema, pero veremos un ejemplo para saber como funciona:

# importamos la clase estimadora que utilizaremos

from sklearn.linear_model import Lasso

# Creamos una instancia de la clase.

lasso = Lasso(alpha=10)

# Utilizamos un método fit en la instancia

lasso.fit(X_train, y_train)